(서울=뉴스1) 신은빈 기자 = 인공지능(AI)의 난제 중 하나는 개와 고양이를 구분할 줄 모른다는 점이었다. 인간의 눈으로 봤을 때 개와 고양이는 엄연히 종이 다른 생명체지만 기계의 눈으로 봤을 때는 같은 포유류에 네 발로 걷는 짐승이라는 점에서 구분이 어려웠던 것이다.

그런데 구글에 새로운 이미지 AI 모델이 개와 고양이를 구분할 수 있는 능력을 갖추게 됐다. 27일 구글은 이해·분석 능력까지 갖춘 범용 시각 인공지능(AI) 모델 '비전 바나나'(Vision Banana) 기술을 공개했다. 이 모델은 기존의 시각 분석 AI가 포유류라는 종류로만 구분하던 개와 고양이를 각기 다른 동물로 구분하는 것은 물론, 같은 고양이도 개별 객체로 구분할 수 있다.

이미지 생성 AI가 '실제처럼 보이는 그림'을 만드는 데 그치지 않고 현실 속 사물의 구조를 세밀하게 분석하는 수준까지 발전한 결과로 풀이된다. 아직 상용화 단계는 아니지만, 향후 정식 모델로 출시될 경우 생성형 AI 하나만으로 정교한 시각 분석 기술을 구현할 수 있을 것으로 기대된다.

구글 딥마인드의 기술 보고서에 따르면 비전 바나나는 구글의 기존 이미지 생성 AI인 '나노 바나나 프로'를 바탕으로 탄생한 프로젝트 기술이다. 나노 바나나 프로에 소량의 시각 작업 데이터를 혼합해 미세 조정했다.

기존의 이미지 생성 기능에 더해, 이미지 출력값을 RGB 이미지(빛의 삼원색인 적색·녹색·청색, 화면에서 보이는 색을 표현하는 색상 모드)로 구분하는 기능까지 탑재했기 때문에 시각 생성과 이해 모두 가능한 것이 특징이다.

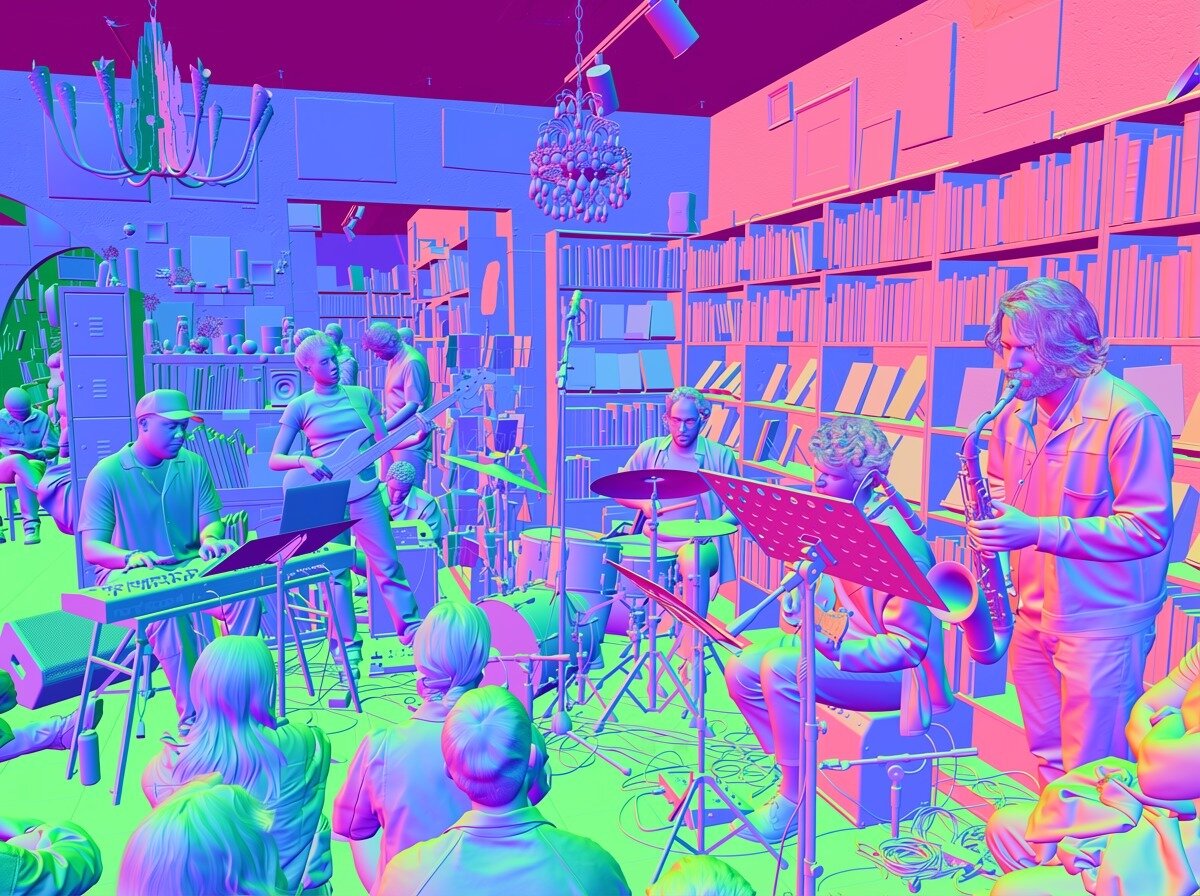

덕분에 프롬프트(명령어)에 따라 여러 사물을 다른 색깔로 구분해 표시해 주고, 같은 종류로 여러 개인 사물도 하나씩 구분이 가능하다. 사진 속 물체의 깊이나 표면의 법선을 추정해 색깔별로 다르게 표시할 수도 있다.

예를 들어 앉아 있는 사람은 노란색, 서 있거나 걷는 사람은 살구색, 바다는 초록색, 울타리는 파란색으로 구분하라는 프롬프트를 입력하면 사진 속에 해당하는 이미지를 모두 인식하고 설정된 색깔대로 구분해서 표시해 준다.

마늘과 고기 조각 여러 개가 섞여 있는 요리 사진에서 마늘 조각만 인식하되 개별 객체로 구분할 수도 있다. 보고서에 첨부된 예시 이미지에서 비전 바나나는 고기와 함께 엉켜 있는 마늘 조각을 모두 다른 색깔로 구분해 표시했다.

구글 딥마인드 연구진은 "비전 바나나는 단일 단어나 명사에서 구에 이르기까지 텍스트 프롬프트로 지정된 모든 (시각적) 요소를 분할할 수 있다"고 설명했다.

비전 바나나는 별도 구조를 바꾸지 않아도 입력하는 프롬프트만 바꾸면 그에 맞게 다양한 작업을 수행할 수 있다. 또 이미지를 출력하는 RGB 색상은 단순한 시각적 요소가 아니라 객체 속성에 맞게 부여한 규칙이기 때문에, 이를 분석하면 어떤 색상이 어떤 객체인지 정확하게 변환할 수 있다는 장점이 있다.

이는 비전 바나나가 기존 컴퓨터 비전 분야에서 이미지를 인식할 때 사용하는 시각 특화 AI가 아닌 생성형 AI를 기반으로 하기 때문이다.

연구진은 챗봇 형태의 생성형 AI가 수집한 답변이 거대언어모델(LLM)의 학습 데이터로 쓰이듯, 이미지 생성 AI의 작업 역시 범용 시각 모델의 사전 학습 역할을 수행할 것이란 가정 아래 비전 바나나 기술 연구를 시작했다고 밝혔다.

연구진은 "미세 조정된 이미지 생성 모델이 생성 능력은 유지하면서 시각 이해 부문에서도 최고 수준의 성능을 발휘한다면 파운데이션 시각 모델(광범위한 시각 분야에 사용될 수 있는 모델)로 나아갈 수 있을 것"이라며 "비전 바나나는 여러 벤치마크(평가 기준)에 걸친 평가 과정에서 시각적 이해와 생성 능력 모두 뛰어나다는 것을 발견했다"고 설명했다.

보고서에 따르면 비전 바나나는 2차원(2D)과 3차원(3D) 과제 모두에서 다른 시각 모델과 비교했을 때 최고 수준에 달하는 결과를 냈다. 2D 분할 과제에서는 분할 특화 모델인 'SAM 3'를 능가했고, 깊이 추정 과제에서는 6개의 벤치마크 점수 평균을 비교한 결과 대상 시각 모델들 중 가장 높은 점수를 냈다.

이번 사례는 모든 시각적 분석을 텍스트 프롬프트에 따른 이미지 생성 과정으로 풀어냈다는 점에서, 복잡한 시각 분석 기술이 생성형 AI 하나로 통합될 수 있다는 가능성을 보여준다.

다만 이 같은 모델을 실제로 사용하기까지는 기존의 경량화된 시각 특화 모델을 사용할 때보다 연산량이 많이 드는 문제 등 해결해야 할 지점이 있다.

연구진은 "대규모 이미지 생성으로 사전 학습된 모델은 자연스럽게 강력한 시각 이해 능력을 습득한다"면서도 "이를 실제로 상용화하려면 현재의 연산 과부하와 비용 절감을 해결할 전략을 개발해야 한다"고 설명했다.

bean@news1.kr