(서울=뉴스1) 김민석 기자 = 구글이 최근 출시한 차세대 인공지능(AI) 모델 '제미나이3' 시리즈의 연구용 확장 버전 '제미나이3 딥싱크'가 AI 추론(Reasoning) 분야 강자로 떠올랐다.

제미나이3 딥싱크는 '인류 최후의 시험'이라 불리는 HLE(Humanity's Last Exam)에서 41%를 기록해 오픈AI 최신버전 'GPT-5.1'(약 26.5%)과 xAI '그록4'(25.4%)를 압도했다.

까다로운 벤치마크로 꼽히는 'ARC-AGI-2'에서도 제미나이3 딥싱크는 역대 최고 점수(45.1%)를 기록하며 GPT-5.1(17.6%)을 크게 앞질렀다. 딥싱크는 대학원 수준 문답 GPQA에선 93.8%를 기록했다.

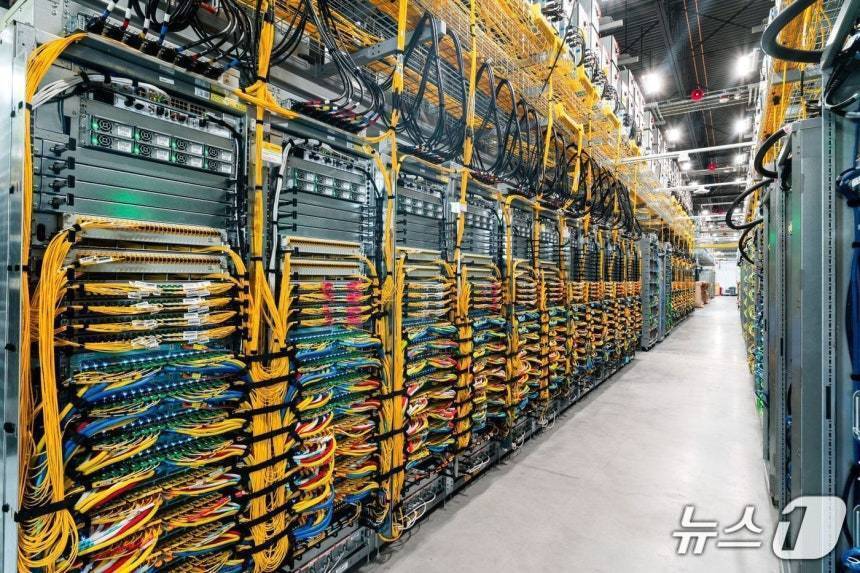

구글은 7세대 텐서처리장치(TPU) '아이언우드'로 제미나이3의 추론 성능을 높였다고 발표했다. 제미나이3 딥싱크로 TPU의 강력한 성능을 입증하면서 TPU 공급 네트워크에 유의미한 영향을 줄 것이란 전망이 나온다.

11일 IT 업계에 따르면 제미나이3 딥싱크는 '딥싱크' 모드의 병렬 추론을 활용해 여러 가설을 동시에 탐색한다. 이 방식은 단일 추론 경로의 기존 모델과 달리 문제 해결 가능성을 폭넓게 검증해 전례 없는 정확도를 구현한다.

고성능 모델엔 높은 추론 비용이 따른다. 제미나이3 딥싱크는 프로 버전(0.81달러) 대비 약 100배 높은 비용(77달러)이 발생하는 것으로 전해졌다.

구글은 딥싱크 모드를 "가장 어려운 문제에만 쓸 가치가 있는 프리미엄 서비스"라고 설명하며 '울트라 구독'(월 250달러·36만 원) 전용 모델로 포지셔닝했다.

제미나이3 딥싱크의 성능 향상은 ASIC(주문맞춤형 반도체) 생태계에 지각 변동을 예고한다.

구글은 지난달 아이언우드를 일반에 공식 출시하며 엔비디아 '블랙웰'과 정면 승부를 선언했다. 아이언우드는 FP8 기준 4.6 페타플롭스(PFLOPS) 성능에 HBM3E 메모리 192GB, 대역폭 7.4TB/s를 탑재했다. 이는 블랙웰 아키텍처 기반의 B200과 동급 수준이다.

앤트로픽에 이어 메타도 내년부터 구글 클라우드를 통해 TPU를, 2027년부터는 자사 데이터센터에 TPU를 탑재하는 방안을 검토하고 나서면서 엔비디아가 긴장하고 있다. 엔비디아가 그간 쌓아온 GPU 독점 체제 균열 가속 신호일 수 있어서다.

구글은 앤트로픽과는 TPU 최대 100만 개분 클라우드 공급 계약을 맺었다.

구글은 TPU를 처음엔 내부 AI 모델 훈련·추론 용도로 활용하다 수년 전부터 구글 클라우드를 통해 일부 외부 고객사에 임대해 왔다. 최근엔 고객사 데이터 센터에 직접 하드웨어를 설치해 주는 온프레미스 모델을 전면에 내세웠다.

구글 클라우드 임원들은 TPU 생태계 확산을 통해 엔비디아 연간 매출의 최대 10%를 확보할 수 있을 것으로 내다봤다.

한편 위기감을 느낀 샘 올트먼 오픈AI CEO는 '코드 레드'를 선언하고 차세대 모델 'GPT-5.2' 출시 일정을 약 2~3주 앞당기는 초강수를 뒀다.

당초 예고된 이달 9일 출시는 불발된 상태다. 제미나이3 프로 성능을 훌쩍 넘는 제미나이3 딥싱크 성능 지표를 넘어야한다는 압박감과 '가짜 벤치마크 유포 논란'이 영향을 끼쳤을 것으로 분석된다.

블록체인 기술 기반 예측 시장 플랫폼 폴리마켓에선 오픈AI가 차세대 모델을 발표한다 해도 제미나이3의 성능 우위가 유지될 것으로 예측됐다.

ideaed@news1.kr

![[단독] 카페24, 도메인 이용료 내달 인상…"환율·시행사 공급가 여파"](https://image.news1.kr/system/photos/2026/5/11/7899979/no_water.jpg/dims/crop/628x439)