(서울=뉴스1) 이정후 기자 = AI 스타트업 트릴리온랩스는 소규모 모델로 거대언어모델(LLM)의 추론 성능을 예측할 수 있는 새로운 방법론 '알브릿지'를 발표했다고 21일 밝혔다.

업계에 따르면 LLM의 추론 능력은 모델이 일정 규모에 도달하기 전까지는 거의 드러나지 않다가 임계점을 넘는 순간 복잡한 수학 문제나 다단계 논리 문제까지 풀어내는 특성을 보인다.

이 때문에 작은 모델로는 대형 모델의 추론 성능을 예측하기 어려워 막대한 비용을 들여 대규모 학습을 반복해야 했다.

트릴리온랩스가 개발한 알브릿지는 이와 같은 한계를 극복하도록 작은 모델(10억 개 이하 매개변수)만을 가지고도 대형 모델(최대 320억 개 매개변수)이 실제로 얼마나 뛰어난 추론 능력을 보여줄지 효과적으로 예측할 수 있도록 설계됐다.

트릴리온랩스에 따르면 언어모델은 '다음 단어를 예측하는 방식'으로 학습되지만 기존에는 다른 기준으로 성능을 평가해 작은 모델의 결과가 큰 모델의 성능을 제대로 보여주지 못했다.

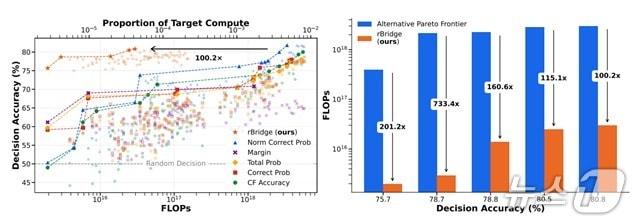

알브릿지는 평가 방식을 학습 목표와 실제 과제에 맞춰 작은 모델이 대형 모델의 성능을 더 정확히 대신할 수 있도록 했다. 이를 통해 데이터셋 평가와 순위 매기기에 드는 비용을 기존보다 100배 이상 줄였다.

또한 기존 방법 대비 최대 733배 높은 효율성을 기록했다. 동일한 예측 정확도를 내는 데 필요한 연산량도 기존보다 훨씬 적었다.

이번 기술은 1억 파라미터보다 더 작은 모델부터 최대 320억 파라미터 규모의 다양한 모델을 대상으로 검증됐으며 총 6개의 핵심 추론 벤치마크를 통해 성능이 확인됐다.

신재민 트릴리온랩스 대표는 "이번 연구 성과는 작은 모델로도 대형 모델의 추론 능력을 신뢰성 있게 예측할 수 있다는 가능성을 처음으로 입증한 것"이라며 "연구자들이 데이터셋과 모델 설계를 훨씬 더 효율적으로 선택할 수 있는 길을 열었다는 점에서 LLM 연구와 AI 생태계의 새로운 전환점이 될 것"이라고 말했다.

leejh@news1.kr