ETRI, 인공지능 안전성·신뢰성 확보 국제표준 선도

- 김종서 기자

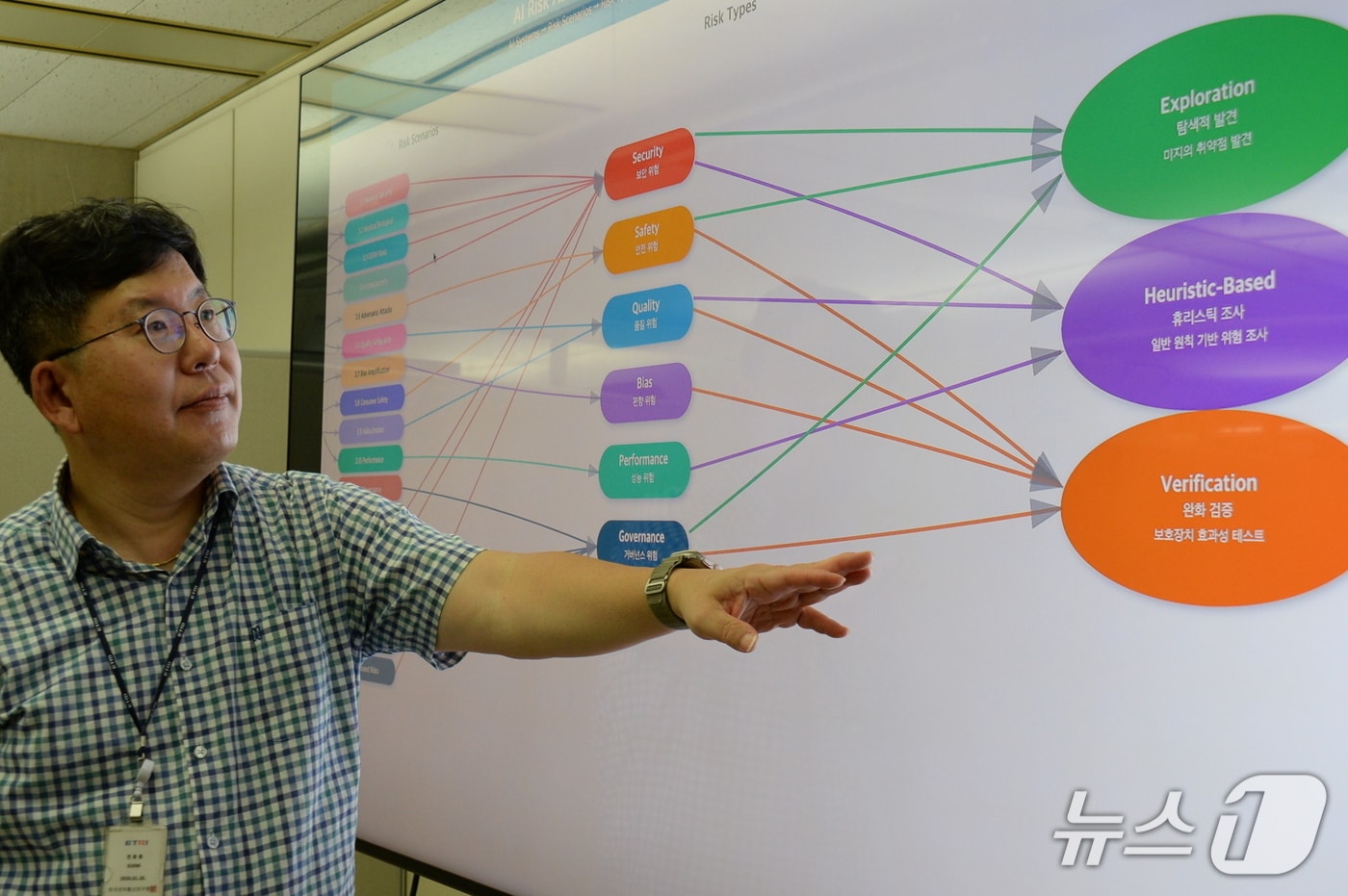

(대전=뉴스1) 김종서 기자 = 한국전자통신연구원(ETRI)은 인공지능(AI) 시스템의 위험을 미리 찾아내는 'AI 레드팀 테스팅' 표준과 소비자가 AI의 신뢰 수준을 쉽게 이해할 수 있는 '신뢰성 사실 라벨(TFL)' 표준을 국제표준화기구(ISO/IEC)에 제안하고 본격적인 개발에 착수했다고 19일 밝혔다.

AI 레드팀 테스팅은 AI 시스템이 얼마나 안전한지를 공격적으로 탐색하며 테스트하는 방법이다. 생성형 AI가 잘못된 정보를 내놓거나 사용자 보호장치를 피해 악용되는 상황을 미리 찾아낸다.

ETRI는 이 분야 국제표준의 에디터 역할을 맡아 의료·금융·국방 등 다양한 분야에 공통으로 적용할 수 있는 국제 공통 시험 절차와 방법을 만들고 있다.

ETRI는 식품의약품안전처와 함께 오는 9월 4~5일 노보텔 서울 동대문 호텔에서 국내 첫 '첨단 AI 디지털의료제품 레드팀 챌린지 및 기술 워크숍'도 개최한다.

이 챌린지는 의료인, 보안전문가, 일반 시민이 참여해 AI의 편향, 위험성 등을 함께 점검해보는 행사다.

서울아산병원과 협력해 의료 전용 레드팀 평가 방법론도 함께 개발 중이다. 첨단 AI 기술을 적용한 디지털의료제품에 대한 레드팀 시험 체계도 만들고 실증 테스팅을 진행할 예정이다. STA·네이버·업스테이지·셀렉트스타·KT·LG AI연구원 등 주요 기업들과 협의체를 구성해 AI 레드팀 국제표준화 협력도 강화하고 있다.

ETRI는 또 기업이 스스로 정보를 제공하거나, 제3의 기관이 검증·인증하는 다양한 방식으로 운영될 수 있는 TFL 시리즈 표준 개발을 주도하고 있다.

향후 AI의 탄소배출량(탄소발자국) 같은 ESG 요소도 반영하는 방안까지 검토 중이다. 이 표준은 인공지능 활용 조직에 대한 국제 인증 표준으로 사용하고 있는 'AI 경영시스템 표준'과도 연계해 개발된 제품 및 서비스가 얼마나 신뢰할 수 있는지 입증할 수 있는 틀로 자리매김할 전망이다.

이승윤 표준연구본부장은 "AI 레드팀 테스팅과 신뢰성 라벨 국제 표준들은 전 세계 AI 시스템의 안전과 신뢰성을 평가하는 공통 기준이 될 것"이라며 "ETRI는 앞으로도 AI 안전과 신뢰성 분야의 국제표준화를 주도해 대한민국이 소버린 AI뿐 아니라 소버린 AI 안전 기술을 이끄는 중심이 되도록 하겠다"고 말했다.

jongseo12@news1.kr

Copyright ⓒ 뉴스1. All rights reserved. 무단 전재 및 재배포, AI학습 이용금지.