국내 연구진, 한국어 특화 저비용·고성능 LLM 개발…온라인 공개

- 김종서 기자

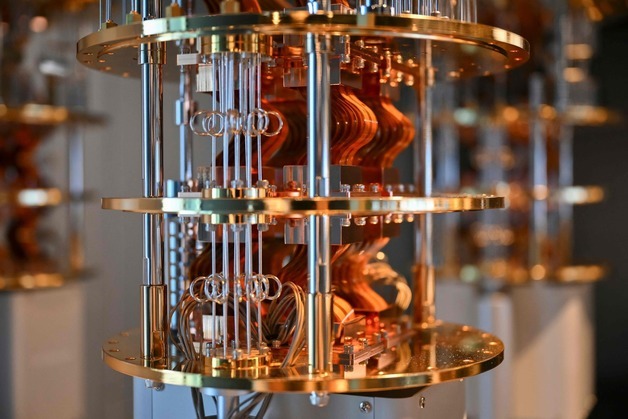

(대전=뉴스1) 김종서 기자 = 국내 연구진이 기존에 공개된 영어 기반 거대 언어 모델(LLM)을 효율적인 방법으로 개량해 천문학적 비용을 들이지 않아도 고성능 한국어 LLM 개발이 가능함을 입증했다.

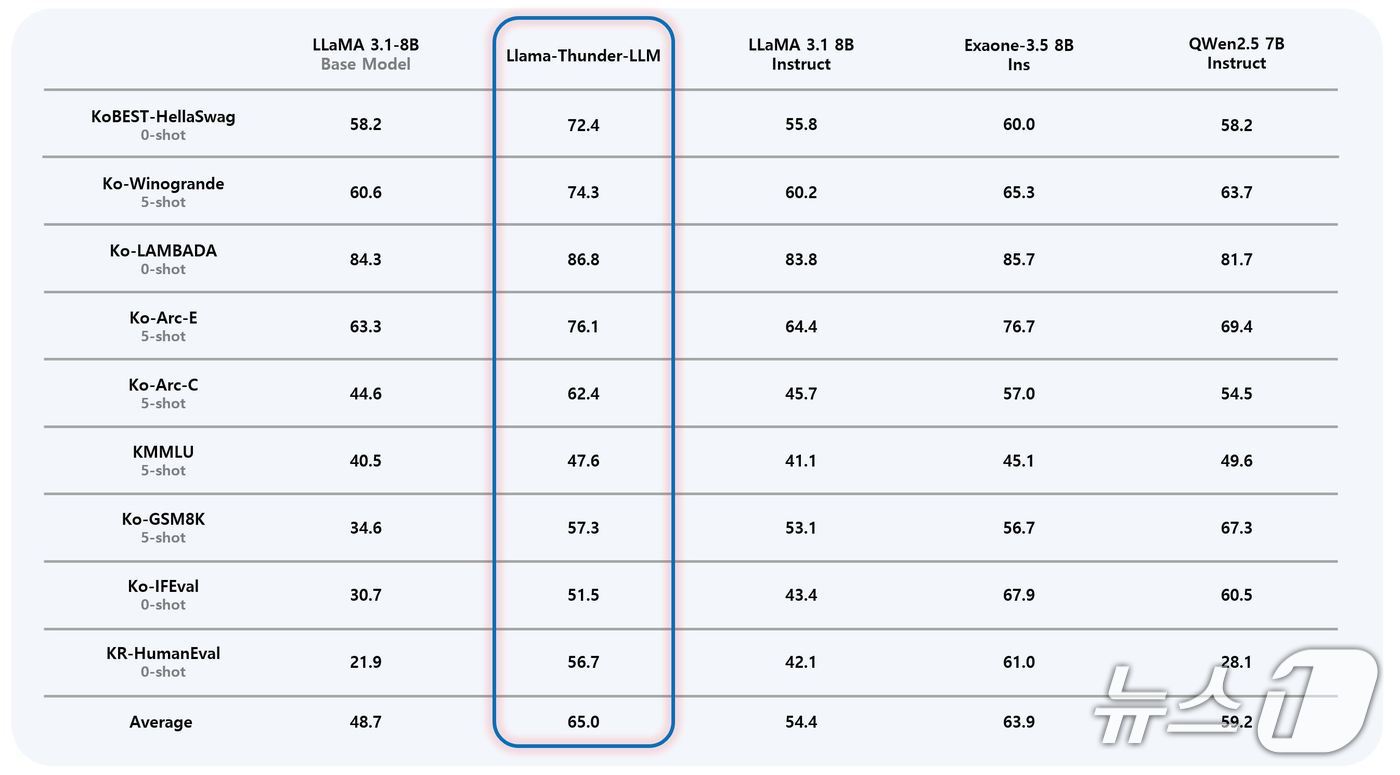

한국연구재단은 서울대학교 이재진 교수 연구팀이 영어 기반 언어 모델 라마(Llama)를 개량해 한국어에 특화된 언어 모델 라마 썬더 LLM(Llama-Thunder-LLM)과 한국어 전용 토크나이저 썬더 톡(Thunder-Tok), 한국어 LLM의 성능을 객관적으로 평가할 수 있는 한국어 벤치마크를 개발해 온라인에 공개했다고 2일 밝혔다.

LLM은 구축에 필요한 데이터가 한정적이고 개발에 막대한 비용이 들어 대기업과 해외 빅테크 기업 외 중소 연구기관 및 대학에서는 연구개발이 여러운 실정이다.

연구팀은 데이터 수집부터 사후 학습까지 언어 모델 학습의 모든 단계를 자체 진행하며 중국의 거대 언어 모델 딥시크(DeepSeek)처럼 제한된 자원으로도 고성능 언어 모델 구축이 가능함을 입증했다.

공개된 영어 모델을 활용했지만 적용한 기술은 독자적인 모델 개발에 필요한 모든 기술을 포함했다. Llama-Thunder-LLM은 3테라바이트(TB)의 한국어 웹 데이터를 수집·전처리해 기존에 공개된 라마 모델에 연속 학습과 사후 학습등 개량 기법을 적용한 한국어 특화 거대 언어 모델이다.

한국어의 문법적 특성을 반영한 토크나이저 Thunder-Tok은 기존 라마 토크나이저 대비 토큰 수를 약 44% 절약해 추론 속도 및 학습 효율성을 높였다.

연구팀이 자체 개발한 한국어 평가용 데이터셋을 포함한 한국어 벤치마크는 한국어 LLM의 성능을 객관적이고 체계적으로 평가할 수 있는 기반을 제공한다.

이 교수는 "이번 연구는 학계도 자주적인 LLM 개발이 가능함을 입증하고 우리나라의 소버린 AI에 기여한 의미 있는 결과"라며 "한국어 기반 LLM 및 토크나이저, 벤치마크 데이터셋을 온라인에 공개하고 개발 과정 또한 상세히 기술해 누구나 후속 및 재현 연구에 활용할 수 있는 기반을 마련했다"고 밝혔다.

이번 연구성과는 '초거대 AI모델 및 플랫폼 최적화 센터' 웹페이지를 통해 누구나 자유롭게 이용할 수 있다.

jongseo12@news1.kr

Copyright ⓒ 뉴스1. All rights reserved. 무단 전재 및 재배포, AI학습 이용금지.