KAIST 연구진, 추론속도 4배 빨라진 '동영상 인식기술' 개발

연산량 8배↓ 메모리 사용 4배↓ '초고효율'

- 김태진 기자

(대전=뉴스1) 김태진 기자 = 국내 연구진이 새로운 패러다임의 동영상 인식기술을 개발했다.

이 기술은 기존 비디오 모델보다 8배 낮은 연산량과 4배 낮은 메모리 사용량으로도 높은 정확도를 기록했다. 추론 속도는 기존 트랜스포머 기반 모델 대비 4배나 향상됐다.

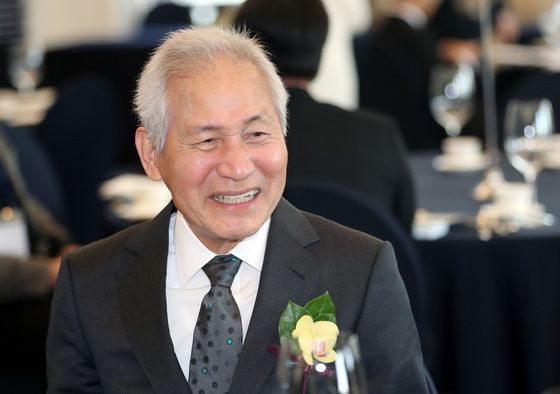

한국과학기술원(KAIST)은 전기및전자공학부 김창익 교수 연구팀이 초고효율 동영상 인식 모델 ‘비디오맘바(VideoMamba)’를 개발했다고 23일 밝혔다.

비디오맘바는 기존 트랜스포머 기반 모델들이 가지고 있는 높은 계산 복잡성을 해결하기 위해 설계된 새로운 동영상 인식 모델이다.

동영상 인식 모델의 효율성을 극대화하기 위해 비디오맘바에 1차원 데이터 처리에 국한된 기존 선택적 상태 공간 메커니즘을 3차원 시공간 데이터 분석이 가능하도록 고도화한 시공간적 전방 및 후방 선택적 상태 공간 모델(SSM)을 도입했다.

이 모델은 순서가 없는 공간 정보와 순차적인 시간 정보를 효과적으로 통합해 인식 성능을 향상한다.

연구팀은 다양한 동영상 인식 벤치마크에서 개발한 비디오맘바의 성능을 검증했다.

이 비디오맘바는 영상 분석이 필요한 다양한 응용 분야에서 효율적이고 실용적인 솔루션을 제공할 수 있다.

예를 들면 자율주행에서 주행 영상을 분석해 도로 상황을 정확하게 파악하고 보행자와 장애물을 실시간으로 인식해 사고를 예방할 수 있다.

또 의료 분야에서는 수술 영상을 분석해 환자의 상태를 실시간으로 모니터링하고 긴급 상황 발생 시 신속히 대처할 수 있다. 스포츠 분야에서는 경기 중 선수들의 움직임과 전술을 분석해 전략을 개선하고, 훈련 중 피로도나 부상 가능성을 실시간으로 감지해 예방할 수 있다.

김창익 교수(교신 저자)는 “비디오맘바의 빠른 처리 속도와 낮은 메모리 사용량, 뛰어난 성능은 우리 생활에서의 다양한 동영상 활용 분야에 큰 장점을 제공할 것”이라고 말했다.

KAIST 전기및전자공학부 박진영 석박사통합과정, 김희선·고강욱 박사과정이 공동 제1 저자, 김민범 박사과정이 공동 저자로 참여한 이번 연구의 결과는 오는 9월 이탈리아 밀라노에서 열리는 컴퓨터 비전 분야 최우수 국제 학회 중 하나인 '유럽 컴퓨터 비전 회의 2024'에서 발표될 예정이다.

memory4444444@news1.kr

Copyright ⓒ 뉴스1. All rights reserved. 무단 전재 및 재배포, AI학습 이용금지.